苹果研究人员发布了Pico-Banana-400K,这是一个包含40万张精选图像的综合数据集,专门用于改进AI系统根据文本提示编辑照片的能力。

这个庞大的数据集旨在解决苹果所说的当前AI图像编辑训练中的空白。尽管像GPT-4o这样的系统可以进行令人印象深刻的编辑,但研究人员表示,由于缺乏基于真实照片构建的充分训练数据,进展受到限制。苹果的新数据集旨在改善这种情况。

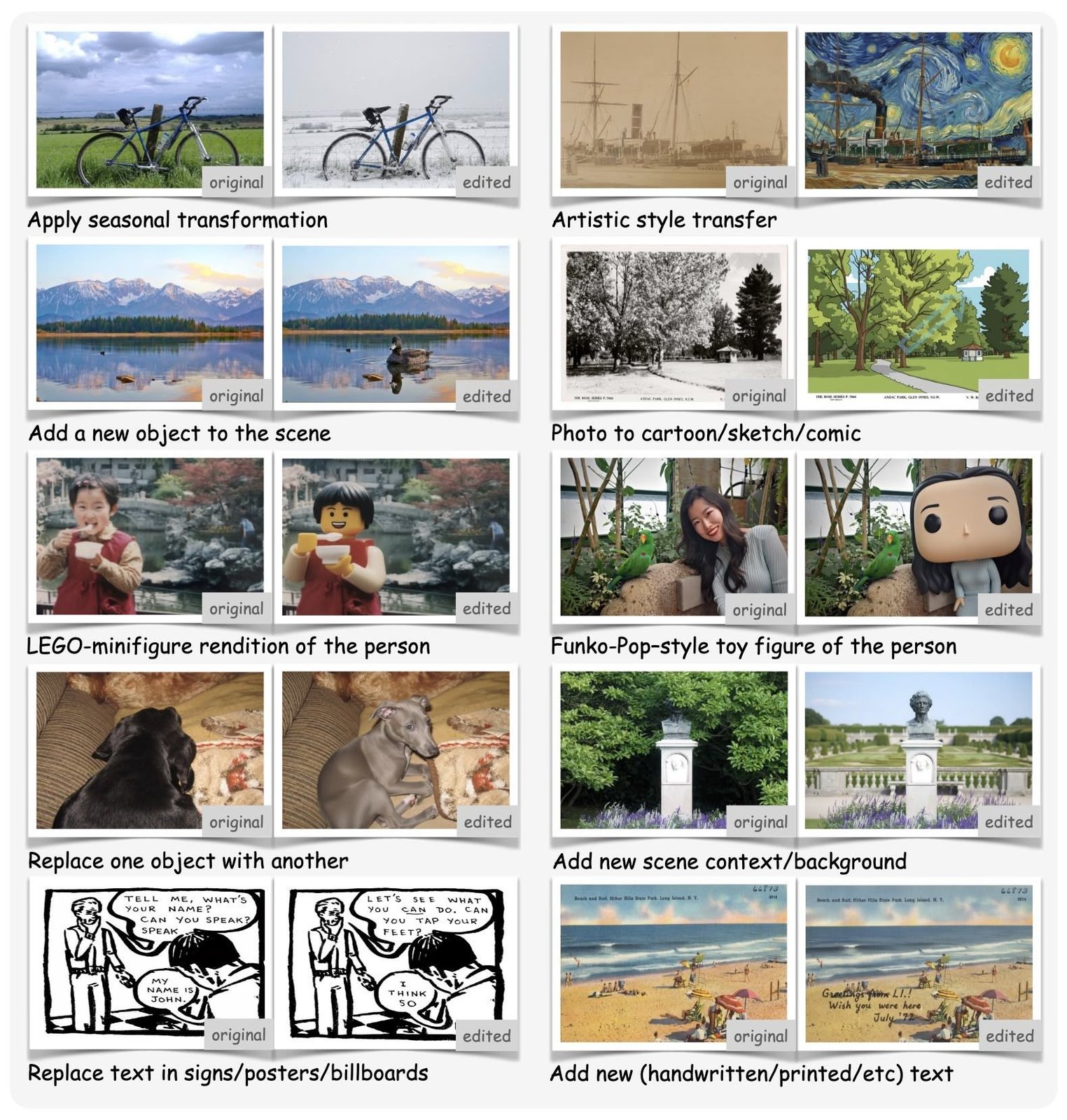

Pico-Banana-400K将图像组织成八个类别下的35种不同编辑类型,从颜色变化等基本调整,到将人物转换为皮克斯风格角色或乐高积木人等复杂变换。每张图像都经过了苹果AI驱动的质量控制系统处理,并使用谷歌的Gemini-2.5-Pro根据指令遵循程度和技术质量来评估结果。

该数据集还包括三个专门的子集:用于基础训练的258,000个单次编辑示例,比较成功和失败编辑的56,000个偏好对,以及展示图像如何通过多次连续编辑演变的72,000个多轮序列。

苹果使用谷歌几个月前发布的Gemini-2.5-Flash-Image(又名Nano-Banana)编辑模型构建了该数据集。然而,苹果的研究揭示了其局限性。虽然全局风格更改的成功率达到93%,但像重新定位对象或编辑文本这类精确任务却表现不佳,成功率低于60%。

尽管存在局限性,研究人员表示,他们发布Pico-Banana-400K的目标是为“训练和评估下一代文本引导图像编辑模型奠定坚实基础”。完整数据集可在GitHub上免费用于非商业研究,开发者可用其训练能力更强的图像编辑AI。